В современном мире искусственный интеллект и машинное обучение становятся неотъемлемой частью множества сфер деятельности, включая бизнес, науку и медицину. Разработка интеллектуальных систем приобретает все большую популярность, и все больше специалистов стремятся внести свой вклад в эту динамично развивающуюся область. Однако, создание эффективных и надежных моделей искусственного интеллекта требует соблюдения ряда ключевых правил и принципов.

В данной статье мы подробно рассмотрим основные аспекты, которые необходимо учитывать при разработке интеллектуальных систем. Особое внимание будет уделено важности качественной разметки данных, выбору наиболее подходящего алгоритма машинного обучения и оценке качества работы модели, а также ее корректному тестированию. Эти элементы являются фундаментальными для создания систем, которые не только работают эффективно, но и соответствуют высоким стандартам надежности и точности.

Следуя этим правилам, разработчики смогут создавать более точные, надежные и эффективные интеллектуальные системы, которые будут успешно решать поставленные перед ними задачи.

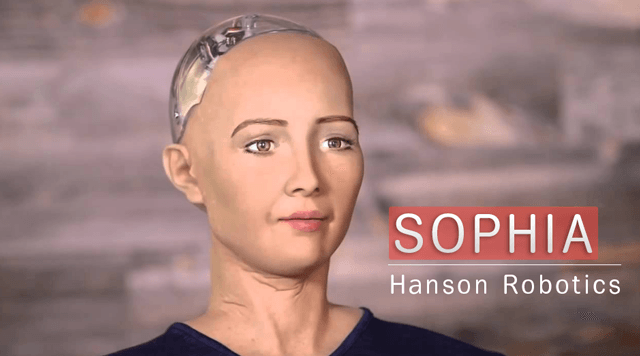

Искусственный интеллект как верный помощник человека

Многие люди испытывают тревогу перед развитием искусственного интеллекта, опасаясь, что он может лишить их самостоятельности. Однако Сатья Наделла, генеральный директор компании Microsoft, убеждает нас в обратном. Он считает, что искусственный интеллект создан не для того, чтобы подчинить человека, а для того, чтобы освободить его от монотонной и опасной работы.

Наделла подчеркивает, что при разработке программного обеспечения для искусственного интеллекта важно предусмотреть функцию аварийного отключения системы. Это гарантирует, что человек всегда будет контролировать ситуацию и сможет вмешаться в работу ИИ в случае необходимости.

Таким образом, искусственный интеллект не представляет угрозы для человеческой самостоятельности, а, наоборот, может стать надежным помощником, который облегчит нашу жизнь и сделает её более безопасной.

Прозрачность AI

По мнению Сатьи, опасения перед развитием искусственного интеллекта, в значительной степени, вытекают из неправильного понимания пользователями правил, на которых данные системы основаны.

Именно поэтому программное обеспечение должно быть прозрачным и простым в использовании. Если так не будет, не только будет расти страх перед искусственным интеллектом, но также он никогда не будет до конца развит.

Системы, основанные на технологии deep learning, а к ним относится множество систем, называемых искусственным интеллектом, требуют постоянного доступа к огромным объемам данных, которые они могут обрабатывать. Но, без сотрудничества с людьми, их возможности остаются ограниченными.

«Взаимодействие людей и программного обеспечения должно быть основано не только на загрузке в программы знаний о людях, но и на изучении обществом принципов работы программ», – подчеркивает директор Microsoft.

Уважение к культурным особенностям

Это правило тесно связано с первым и подчеркивает важность понимания и уважения к культурным различиям. При разработке программного обеспечения инженеры должны осознавать, что общества по всему миру имеют свои уникальные особенности и могут значительно отличаться не только друг от друга, но и внутри себя.

Создание действительно качественной системы требует от разработчиков не только учитывать технические аспекты, но и понимать, как пользователи из разных культур воспринимают и используют продукт.

Правильно спроектированная система должна не только предлагать объективно лучший вариант решения, но и адаптировать его под специфические потребности и предпочтения пользователей. Это позволяет сделать продукт более удобным и привлекательным для широкой аудитории, а также способствует созданию положительного пользовательского опыта.

Защита конфиденциальности

В эпоху интернета защита персональных данных является одной из величайших задач, стоящих перед инженерами, создающими программное обеспечение. Даже небольшая огреха в системе безопасности может привести, например, к взлому банковского счета.

Именно поэтому, по мнению Сатьи Наделлы, искусственный интеллект должен не только усердно охранять данные, но и знать, кому их предоставлять. По его мнению, только таким образом общество может построить в себе доверие к системе, необходимое для его правильной работы.

Объективность искусственного интеллекта

Проблема объективности искусственного интеллекта (ИИ) волнует многих. Она касается не только разработчиков, но и пользователей, которые сталкиваются с результатами работы ИИ. Важно, чтобы ИИ был справедливым и не допускал дискриминации.

Создатели ИИ должны уделять особое внимание этому вопросу. Сатья Наделла, руководитель Microsoft, подчеркивает, что разработчики несут ответственность за создание объективных и справедливых программ. Они должны понимать, что даже небольшие ошибки в коде могут привести к серьезным последствиям.

Например, если программа будет дискриминировать людей по какому-либо признаку, это может привести к несправедливости и нарушению прав человека. Разработчикам необходимо постоянно анализировать и улучшать свои алгоритмы, чтобы избежать подобных ситуаций.

Кроме того, важно, чтобы пользователи могли доверять ИИ. Для этого необходимо, чтобы разработчики были прозрачны в своих действиях и объясняли, как работают их программы. Это поможет пользователям понять, что ИИ действительно объективен и не допускает предвзятости.

Таким образом, объективность ИИ — это не просто техническая задача, а этическая проблема, которая требует внимания и усилий со стороны всех участников процесса. Разработчики должны стремиться к созданию справедливых и объективных программ, а пользователи — доверять им и требовать прозрачности. Только так можно обеспечить, чтобы ИИ служил на благо общества и не нарушал права человека.